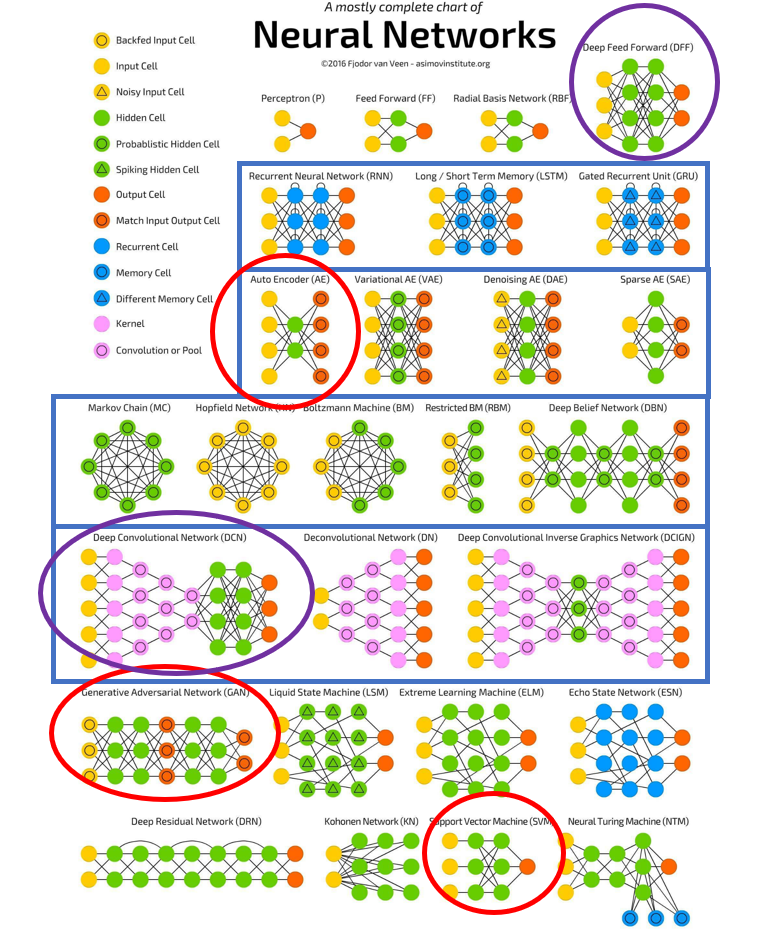

今天我們會把 Asimov Institute 的 Fjodor van Veen 整理的這張神經網路表中還沒講的藍色框框講完,並對神經網路這個主題(Day5~Day20)做個小結。

這篇提到的神經網路模型大部分都還在研究熟悉中,且與手寫數字辨識系統關連不大(但學神經網路時多少會遇到),大家看看即可w

紫色圈圈 → [DAY19] 神經網路模型有哪些?種類與使用介紹(MLP/CNN)

紅色圈圈 → [DAY20] 神經網路模型有哪些?種類與使用介紹2(SVM/GAN/Auto Encoder)

中文翻成

這幾個都是走自然語言處理(NLP)領域一定要會的神經網路模型們!

現在聽到有人說他們的模型有用到 RNN,通常就是有用到 LSTM 或 GRU

其他與這系列相關的神經網路模型:Transformer

請見 [DAY20] 神經網路模型有哪些?種類與使用介紹2(SVM/GAN/Auto Encoder)

對我來說馬可夫鏈並不是神經網路,而是機率方法,所以應該是要放在明天要講的可以用在手寫數字辨識系統上除了神經網路的機器學習方法講 → 隱馬可夫鏈(HMM, Hidden Marcov Chain)。

不過因為受限波茲曼機(RBM, Restricted Boltzmann Machine)跟深度信念網路(DBN, Deep Belief Networks)運算上有用到馬可夫鏈,這邊就先稍微提一下什麼是馬可夫鏈(Markov Chain)。

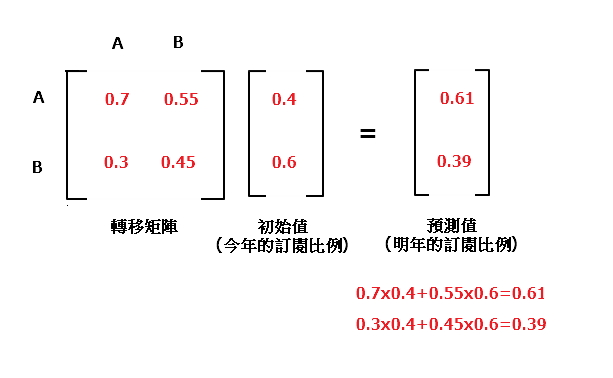

馬可夫鏈簡單來講就是狀態之間轉換的機率。這邊推薦看 我,傑夫。開發人 的 馬可夫鏈(Markov chain)概念 訂閱報紙舉例。

圖片來源:馬可夫鏈(Markov chain)概念 (熟悉的感覺)(x)

回到神經網路的概念,目前幾乎沒有人在用 RBM 或深度信念網路了,這邊推薦看 寫點科普 的 耗時三十年,深度學習之父Hinton是怎麼讓一度衰頹的類神經網路重迎曙光的呢?,裡面有提到 RBM 跟 深度信念網路 的出現跟消失原因。

ps. 霍夫曼網路(hopfield network),這個我目前只在認知科學領域、語意網路相關的書籍文獻中看到它而已,程式實作與應用上會走向內容定址記憶體(content-addressable memory)之類的領域。

CNN 的簡單介紹請見 [DAY19] 神經網路模型有哪些?種類與使用介紹(MLP/CNN)

另外兩個可以把它看成 CNN 的 decoder (Deconvolution Network) 和 CNN+DN 得出的網路模型(DCIGN)

還有一些不在表上的神經網路,如強化式學習的DQN,架構在 Encoder-Decoder 上的Transformer 和進階版 BERT、機器自己學怎麼學得 meta learning。

這邊對利用神經網路實作手寫數字辨識系統這一段做個總結。

在這一個部分我們使用 keras 套件實作手寫數字辨識系統,講解神經網路意義並知道程式結果可以怎麼調整,以及透過實作認識了一些神經網路模型。

在透過手寫數字辨識系統學習機器學習的30天裡,我們花了一半的時間講神經網路,主要是因為神經網路就是目前學機器學習的顯學。不過讓機器擁有像人類一樣懂分類會預測判斷的方法可不只有神經網路,明天我們會整理介紹其他可以用在手寫數字辨識系統的機器學習方法~

明天見!